Все новости

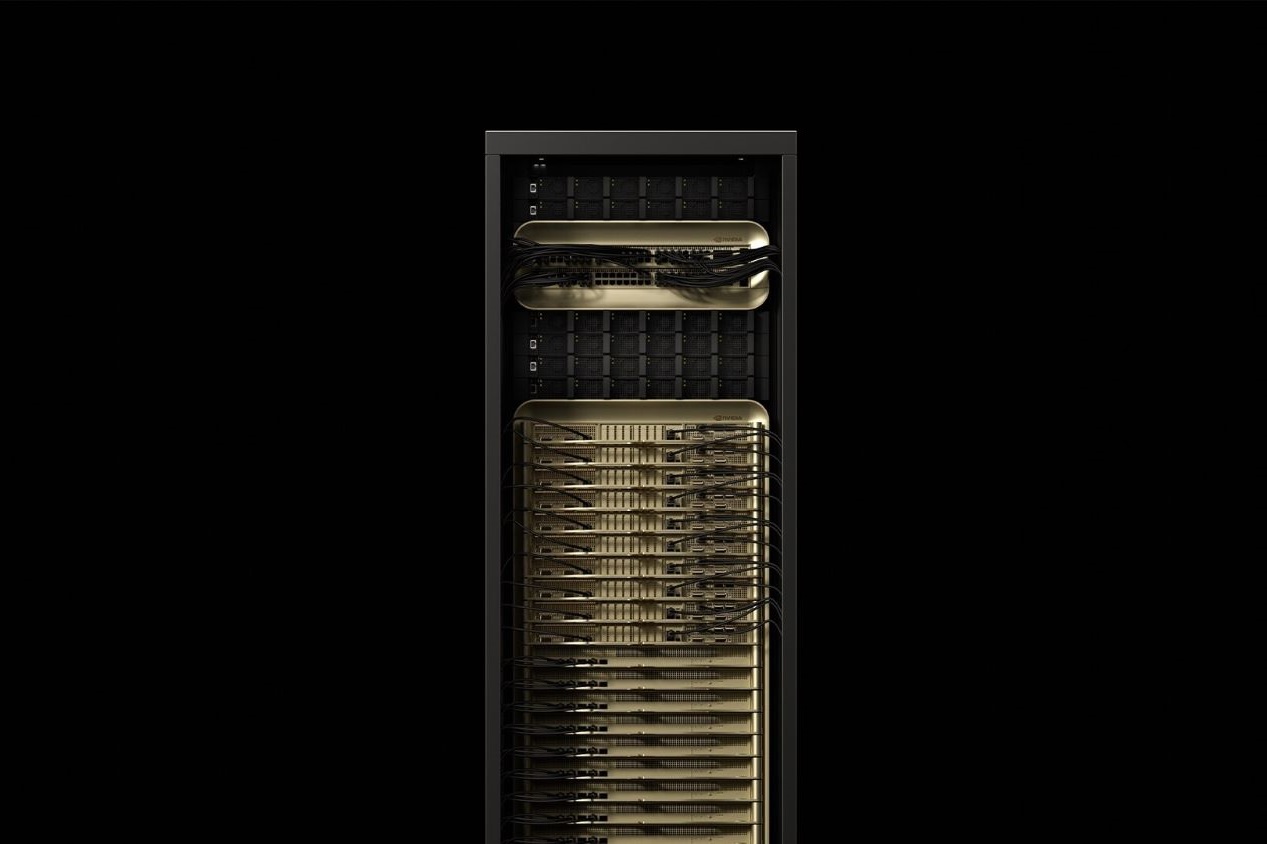

Nvidia представила Blackwell Ultra — самый мощный GPU для агентного ИИ

Новый чип создан для масштабного reasoning, физического ИИ и продвинутого AI inference. Внутри — 72 видеокарты, 800 Гбит/с на GPU и охлаждение по полной.

Прощай, ChatGPT-4: как искусственный интеллект успел изменить мир — и сам себя

ChatGPT-4 официально ушёл на покой — модель, которая за два года сделала из ИИ не просто хайп, а инструмент, влияющий на бизнес, образование и даже политику. Я вспоминаю путь легенды, оцениваю последствия и готовлюсь к следующей стадии эволюции. Турбо-режим включён.

Pinterest против ИИ-спама: новые метки и фильтры для генеративных изображений

Платформа вводит глобальные инструменты для борьбы с ИИ-контентом — теперь пользователи смогут отличать нейросетевое от настоящего и видеть меньше «цифровой каши».

ChatGPT — самое скачиваемое приложение марта: обогнал TikTok и Instagram благодаря стилю Studio Ghibli

В марте 2025 года ChatGPT внезапно стал самым скачиваемым приложением в мире, обогнав даже привычных гигантов — TikTok и Instagram. По данным аналитической платформы Appfigures, искусственный интеллект от OpenAI собрал 46 миллионов установок за месяц, став лидером в глобальных чартах неигровых приложений.

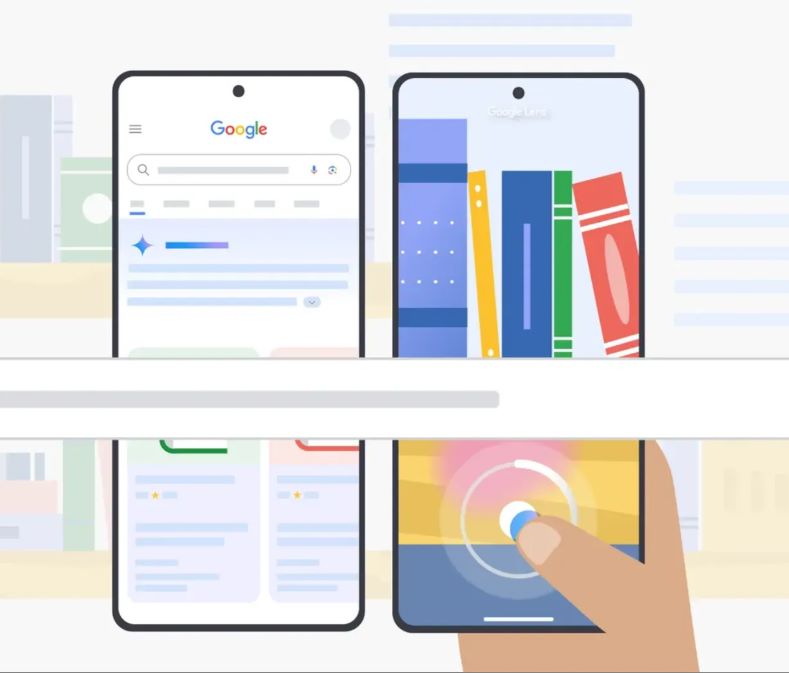

Google врубает «AI-глаза»: теперь поиск понимает, что ты сфоткал, и отвечает как человек

Google снова лезет в будущее. На этот раз они прикрутили визуальный ИИ к поиску: теперь AI Mode понимает не только текст, но и то, что ты показываешь ему на фотке. И это не просто «что на картинке», а полноценный диалог с изображением — с контекстом, логикой и рекомендациями.

Meta представила Llama 4: мощные AI-модели, конкурент GPT-4 и «открытый» исходник с ограничениями

Meta снова в деле. Компания анонсировала Llama 4 — новую линейку своих ИИ-моделей, которые теперь крутятся внутри ассистента Meta AI и уже живут в WhatsApp, Messenger, Instagram и на вебе. Если вы думали, что очередной ИИ-пет-проект — нет, тут всё серьезно: сразу три модели, красивые названия и многообещающие цифры.

OpenAI запустила бесплатную генерацию изображений в ChatGPT, но есть нюансы

Теперь все пользователи ChatGPT могут баловаться генерацией изображений – так заявил CEO OpenAI Сэм Альтман в X (да-да, в Twitter-е, который теперь с "иксом"). Раньше эта фича была доступна только тем, кто платил за подписку, но теперь OpenAI решила немного снизойти до простых смертных.